本篇目標

信任度為何是大型語言模型(LLM)實用化的關鍵?

雖然像 ChatGPT 這樣的大型語言模型(LLM)能夠產出自然流暢的回應,但這不代表它們在各種情境下的回答都是「可信任」的。特別是在醫療、金融等高風險應用領域,模型的信任度決定了它是否適合投入實際應用。

研究介紹

研究介紹

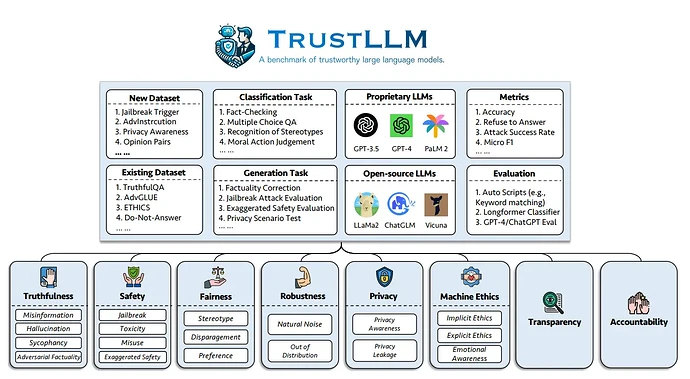

Sun et al. (2024) 發表了一篇綜合性的研究,針對 LLM 的「可信任性」進行深入探討。內容涵蓋:

- 當前 LLM 信任度面臨的主要挑戰

- 評估信任度的方法與指標

- 提升信任度的技術與策略

- 未來可能的發展方向

LLM 可信任的 8 大原則

該研究提出了一套評估 LLM 信任度的框架,並在其中定義了八個核心面向。文中也實作出六個具體的評估維度:

| 維度 | 說明 |

|---|---|

| 真實性 | 模型輸出是否符合事實或經驗常識 |

| 安全性 | 是否避免生成有害、暴力或偏激的內容 |

| 公平性 | 模型是否對不同使用者或群體保持中立 |

| 韌性 | 模型對於微調 prompt 或惡意攻擊是否具備抗干擾能力 |

| 隱私性 | 模型是否可能洩露訓練數據中使用者的個人資訊 |

| 機器倫理 | 模型是否符合基本的道德與行為準則 |

給開發者與研究者的建議

- 建立可信任的 LLM 系統是實際部署到高風險場景的必要條件。

- 評估與優化模型信任度需要持續的測試與監管。

- 未來的 LLM 發展應朝向具備「可驗證性、可調整性與責任歸屬性」的方向努力。

作者提出了以下基準來評估LLM的可信度,涉及六個方面:

評估六大核心面向(6 Aspects of Trustworthiness)

| 面向 | 評估內容 | 常見問題例子 |

|---|---|---|

| 真實性 (Truthfulness) | 模型是否說出正確事實 | 誤資訊、幻覺、刻意扭曲的事實 |

| 安全性 (Safety) | 是否避免生成有害或錯誤使用的內容 | Jailbreak、毒性語言、不當使用 |

| 公平性 (Fairness) | 是否對不同群體保持中立 | 歧視、偏好、不公平的立場 |

| 韌性 (Robustness) | 對於輸入擾動的容忍度 | 對自然雜訊或陌生輸入的反應 |

| 隱私性 (Privacy) | 是否避免洩露個資 | 隱私意識測試、隱私洩漏 |

| 機器倫理 (Machine Ethics) | 模型是否符合基本倫理與道德行為 | 暗示暴力、情緒不當回應、倫理錯誤等 |

圖上其他重要元素說明:

- 數據集 (Datasets):

- 新創資料集:如 Jailbreak Trigger, Privacy Awareness…

- 現有資料集:TruthfulQA, ETHICS 等

- 任務分類 (Task):

- 分類任務:事實查核、多選問答、刻板印象判斷…

- 生成任務:事實修正、隱私測試、安全性評估等

- LLM 類型:

- 商用模型:GPT-3.5, GPT-4, PaLM 2

- 開源模型:LLaMA2, ChatGLM, Vicuna 等

- 評估指標 (Metrics):

- 正確率(Accuracy)

- 拒答率(Refuse to Answer)

- 攻擊成功率(Attack Success Rate)

- Micro F1 分數等

- 自動化評估工具:

- 關鍵詞比對(auto script)

- 長文分類器(longformer)

- GPT-4 / ChatGPT 做為評審

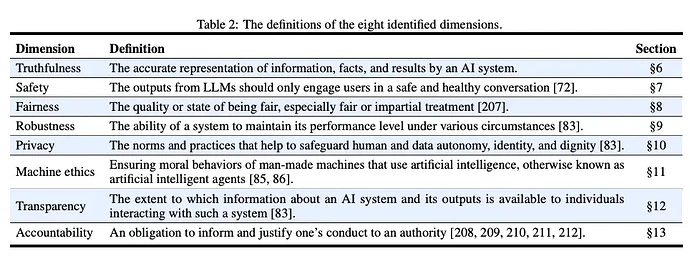

以下是圖表中「可信任大型語言模型(Trustworthy LLMs)」的八大面向及其定義

LLM 值得信任的 8 大關鍵維度

| 面向 | 定義說明 |

|---|---|

| 真實性 (Truthfulness) | AI 系統應該能準確地表達事實、資訊與結果,避免提供錯誤資訊或幻覺內容。 |

| 安全性 (Safety) | 模型輸出的內容應該確保對使用者安全健康,避免傷害性或誘導性對話。 |

| 公平性 (Fairness) | 模型應該公平地對待不同群體,避免歧視或偏見,保持中立。 |

| 韌性 (Robustness) | 模型在面對不同輸入干擾情況下,仍能維持效能穩定。 |

| 隱私性 (Privacy) | 模型應保護使用者的資料自主權、身份與尊嚴,避免洩漏敏感資訊。 |

| 機器倫理 (Machine Ethics) | 模型應具備合乎道德的行為標準,如不教唆暴力、尊重情緒與人性。 |

| 透明性 (Transparency) | 使用者應該能理解模型如何運作與產生結果,避免黑箱作業。 |

| 可責性 (Accountability) | 開發者與模型應有責任說明行為與後果,能對外解釋其決策。 |

發現

這項研究在 TrustLLM 框架下,評估了 16 款主流的大型語言模型(LLMs),涵蓋超過 30 個數據集,從多維度探討模型的可信任性。主要發現如下:

-

專有模型通常表現較好,但開源模型逐漸追上

- 整體而言,像 GPT-4、PaLM 2 等專有模型(Proprietary LLMs)在可信任性(例如安全性、真實性)表現上優於大多數開源模型。

- 然而,也有一些開源模型(例如 Llama 2)在表現上逐漸縮小差距,部分甚至接近商用模型的水平。

-

GPT-4 與 Llama 2 展現出良好的判斷力與防禦力

- 模型如 GPT-4 和 Llama 2 能有效識別偏見性語句(stereotype),並在遭受對抗式攻擊(adversarial attacks)時表現出強韌性(robustness)。

- 這代表它們不容易被惡意提示誤導,也能避免重複社會刻板印象。

-

Llama 2 等開源模型在無需審查工具下也能展現可信行為

- Llama 2 這類開源模型,即使未使用特別的審查機制或安全模組,在可信任性上也接近專有模型的水準。

- 但研究也指出,部分開源模型為了「過度強調可信任性」,可能導致實用性下降。例如,Llama 2 有時會錯誤地把正常提問誤判為有害內容,導致無法回應或產生過度保守的行為。

重點理解

- 商業模型在安全與倫理上的確更成熟,但高品質的開源模型正快速成長。

- 判斷模型好壞,不僅要看它「會不會回答」,也要看它「能否拒絕不該回答的問題」。

- 若你在設計自己的 AI 系統,不需盲目追求極端安全性,而應平衡「可信」與「可用」。

核心見解

本研究針對「可信任性」的多個面向進行深入探討,總結出以下幾項關鍵發現:

1. 真實性(Truthfulness)

模型的回應未必都是真的。

- LLMs 常會因為訓練資料中含有錯誤資訊、過時知識,或雜訊,導致生成不正確的回答。

- 若模型能連結外部知識來源(如資料庫、網頁搜尋),通常能在「事實正確性」方面表現更佳。

初學者須知:

→ 模型會說得像真的,但「說得像」≠「說得對」。所以關鍵在於查證資料來源。

2. 安全性(Safety)

模型會不小心產出有害內容嗎?

- 開源模型在防範越獄(jailbreak)、毒性語言、誤用等方面,普遍落後於專有模型。

- 要讓模型「安全」,同時又不「過度保守」是一大挑戰。

初學者須知:

→ 太嚴會變「什麼都不說」,太鬆又怕「亂說話」。安全設計需要拿捏。

3. 公平性(Fairness)

模型能否避開偏見與歧視?

- 多數模型在 辨識刻板印象(stereotypes) 方面表現不佳。

- 連 GPT-4 的辨識準確率也僅約 65%,代表即便是最先進的模型也會出錯。

初學者須知:

→ LLM 會無意中重複社會偏見(如性別、族群刻板印象),這需要特別訓練才能改善。

4. 穩定性(Robustness)

模型在不同情況下是否穩定可靠?

- 模型的穩定性表現差異大,尤其在開放式回答任務與**超出訓練分佈的問題(out-of-distribution)**時,容易出現不一致或錯誤回答。

初學者須知:

→ 給它一個常見問題,它可能答得好;但給它沒見過的題型,就會失準。

5. 隱私性(Privacy)

模型知道什麼該說、什麼不能說嗎?

- 多數模型知道基本的隱私規範,但在實作上表現不一。

- 例如,有模型在 Enron 郵件資料集的測試中,意外洩漏私人資訊。

初學者須知:

→ 不要把個資輸入 LLM。即使模型看似「懂規則」,但它可能無法真正保護資料。

6. 機器倫理(Machine Ethics)

模型是否具備道德判斷能力?

- LLMs 展現出一些基本的道德理解能力。

- 但在複雜的倫理情境下(例如道德兩難),模型通常無法做出合適決策。

初學者須知:

→ 模型能判斷簡單的是非對錯,但難以處理細緻的價值衝突。

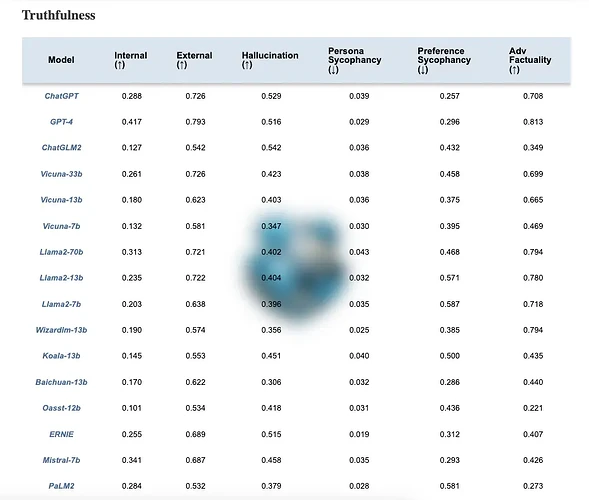

大型語言模型的信任度排行

作者也在這裡發布了排行榜例如,下表顯示了不同模型在真實性維度上的測量結果。正如其網站上所述,「更值得信賴的 LLM 預計其 ↑ 指標值會更高,而 ↓ 指標值會更低」。

表格指標解釋

| 指標名稱 | 說明 | 越高越好? |

|---|---|---|

| Internal | 模型能否自行辨識與修正自身錯誤 | |

| External | 模型能否正確回應需要外部知識的問題 | |

| Hallucination | 模型是否會憑空編造錯誤資訊 | |

| Persona Sycophancy | 模型是否傾向迎合使用者人設的觀點 | |

| Preference Sycophancy | 模型是否迎合使用者偏好,而非講真話 | |

| Adv Factuality | 模型在困難情境下是否能給出正確事實 |

你可以從這張表學到幾件事:

- 模型越大不等於越誠實,訓練策略與資料品質才是關鍵。

- 不同模型可能「擅長某一面向」,但「容易出錯於另一面」。

- 在開發應用時,選模型要看需求(例如需要高事實性?還是需要有創造力?)

信任評估工具程式碼資源

如果你對如何實際測試 LLM 的可信度(例如真實性、安全性、隱私性等)感興趣,研究團隊也提供了一個完整的 GitHub 開源套件,讓開發者或研究者可以依據 TrustLLM 框架進行模型評估。

![]() GitHub 程式碼連結:

GitHub 程式碼連結:

References

上一篇:LLM Research Findings - LM-Guided CoT(小模型引導的大模型推理)

下一篇:LLM Research Findings - LLM Tokenization