LLM 的記憶力:可以記住多長的提示?

影片介紹:LLMs Can Memorize Thousands of Tokens?!

這支影片以簡單易懂的方式說明大型語言模型(LLMs)是否真的能記住很長的上下文,並搭配 2024 年 Machlab 與 Battle 發表的研究,探討不同模型在提示長度與資訊位置變化下的「回憶能力(in-context recall)」。

論文重點整理(Machlab & Battle, 2024)

論文重點整理(Machlab & Battle, 2024)

- 研究名稱:LLM In-Context Recall is Prompt Dependent

- 研究方法:

- 使用「Needle-in-a-Haystack(大海撈針)」任務:

- 在提示中插入一段資訊(針)。

- 詢問模型是否能正確回憶那段資訊。

- 測試提示長度、位置、格式、語意的變化對回憶率的影響。

- 使用「Needle-in-a-Haystack(大海撈針)」任務:

主要發現

- 模型大小不同 → 記憶力差異大

- 模型越大,越能記住更深、更遠的資訊。

- 小小提示改動 → 回憶能力大幅波動

- Prompt 的語句順序、用詞微調都會影響 LLM 是否記住關鍵資訊。

- 訓練資料內容會干擾回應品質

- Prompt 與訓練語料若有衝突,會導致模型產出偏誤或遺忘。

- 提升回憶力的方法:

- 增加模型參數規模

- 改進 Attention 機制

- 採用更有效的訓練策略與微調方法(Fine-tuning)

成果圖解讀

成果圖解讀

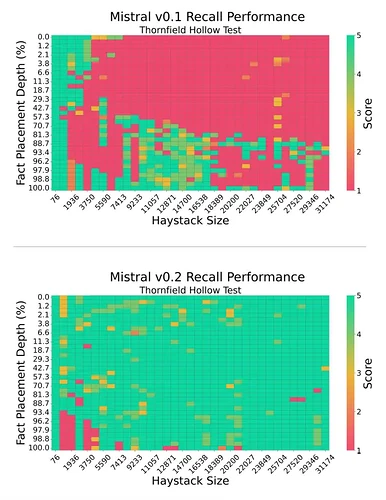

Mistral v0.1 vs. v0.2 的回憶表現對比

- 上圖(v0.1):大部分區域呈現紅色(分數低),代表模型在長提示或針藏得深時幾乎無法回憶。

- 下圖(v0.2):更多區域呈現綠色(分數高),顯示新版模型顯著改善了回憶能力,即使針藏得比較深也能正確回應。

結論:模型升級(如 v0.2)能提升記憶力,但仍需注意提示設計。

實用建議與啟示

- 提示設計至關重要:再小的語句差異都可能影響模型是否能回想起「前文關鍵資訊」。

- 建立持續評估機制:開發者在部署應用時應定期測試模型記憶力。

- 根據任務選模型與設計策略:長文本回憶型任務建議選擇大模型,並針對結構做精細設計。

References

LLM In-Context Recall is Prompt Dependent

上一篇:LLM Research Findings - RAG 模型的忠實度

下一篇:LLM Research Findings - RAG 有助於降低幻覺生成